Déploiement d'un Cluster VMware vSAN

Ce projet visait à mettre en place un cluster vSAN pour garantir la haute disponibilité, la tolérance aux pannes et une meilleure gestion des ressources dans une infrastructure virtualisée.

Qu’est-ce qu’un cluster VMware vSAN et comment le déployer ?

Un cluster VMware vSAN (Virtual SAN) est un système de stockage distribué qui regroupe les disques de plusieurs hôtes ESXi

pour former un espace de stockage partagé et redondant.

Chaque hôte du cluster apporte ses propres ressources (CPU, RAM, disques),

et vSAN utilise ces disques pour créer un datastore commun.

Ce type de cluster assure la haute disponibilité des machines virtuelles

et la continuité de service en cas de panne.

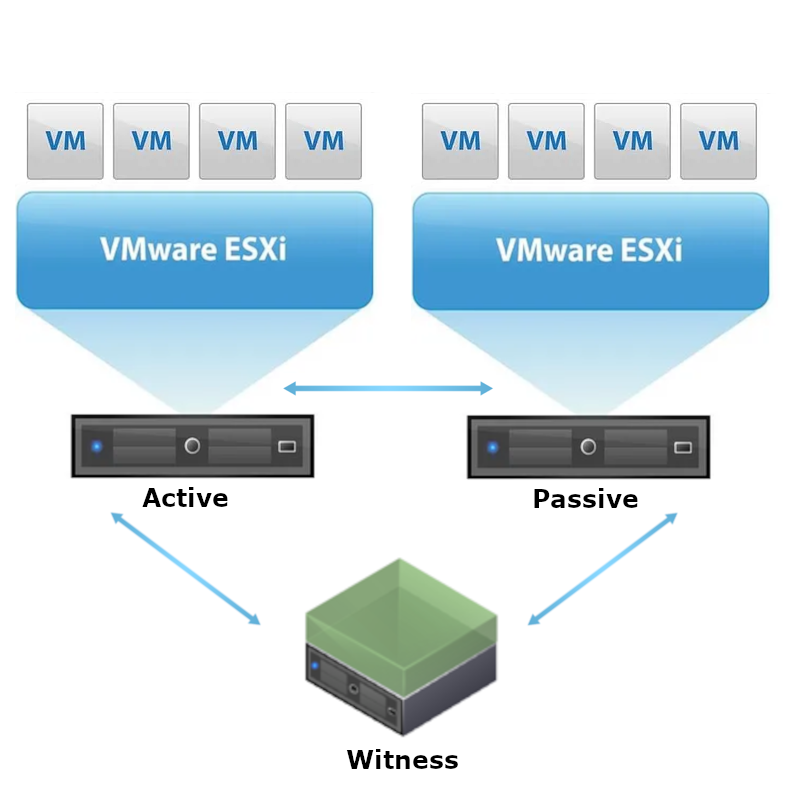

Dans le cas d’un cluster vSAN à 2 nœuds, un nœud Witness est nécessaire.

C’est une machine virtuelle située en dehors du cluster,

qui permet de surveiller l’état des serveurs et de décider automatiquement

lequel doit continuer à fonctionner en cas de coupure ou de défaillance d’un hôte.

Il joue un rôle essentiel pour éviter les erreurs et garantir le bon fonctionnement du cluster.

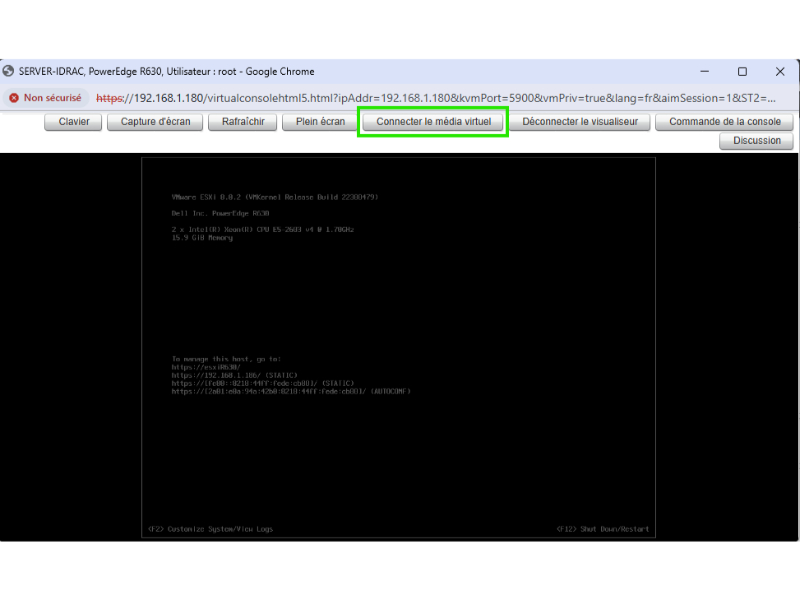

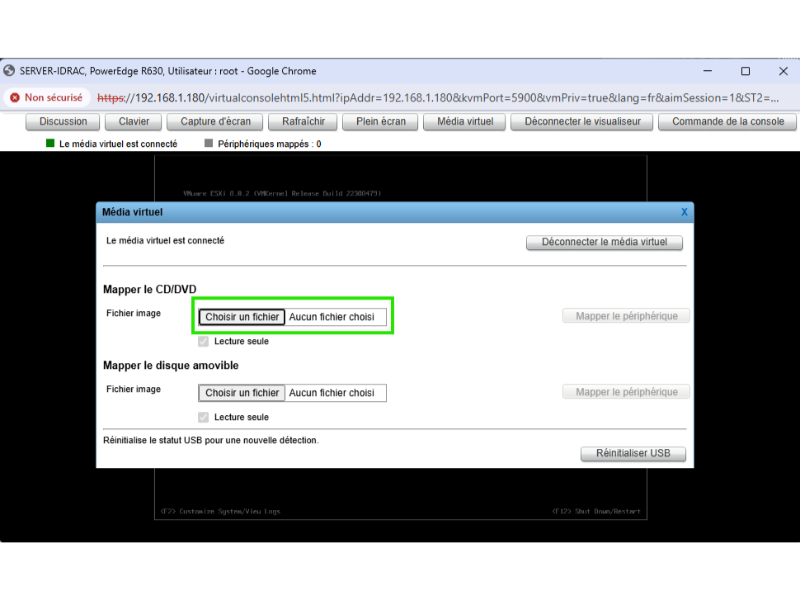

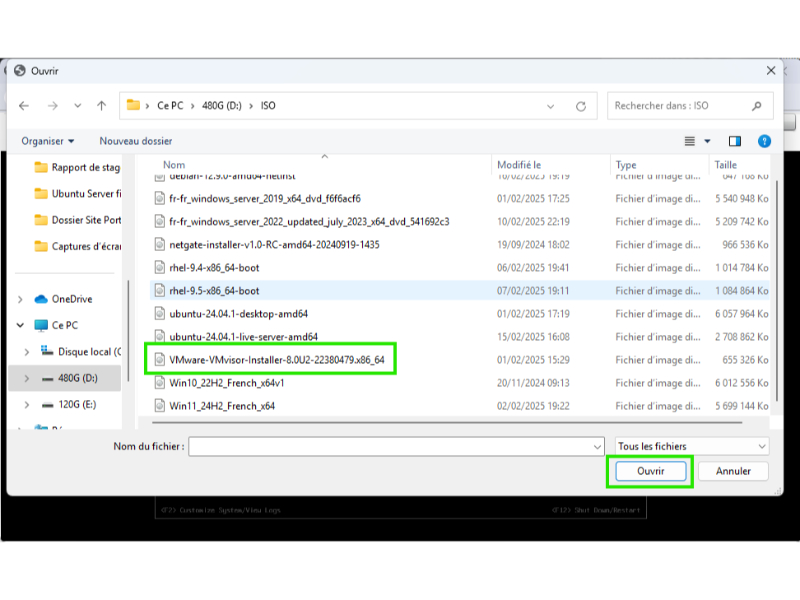

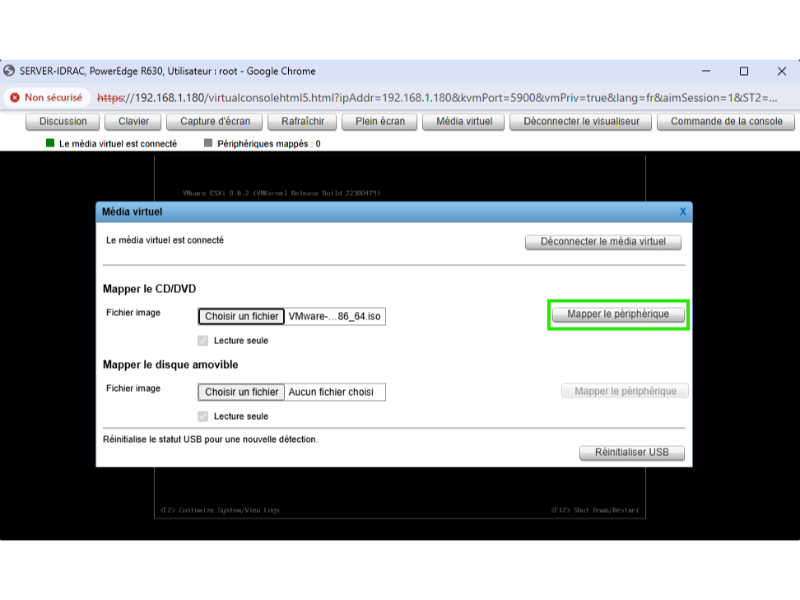

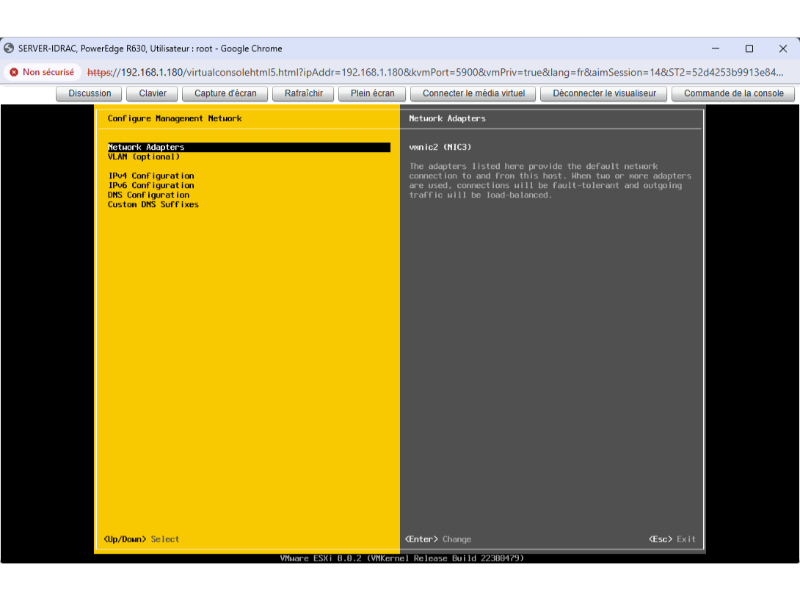

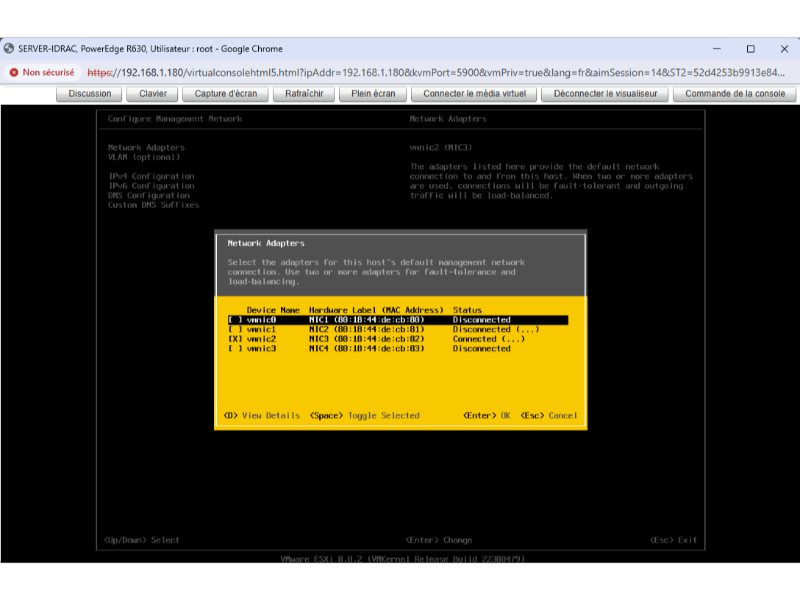

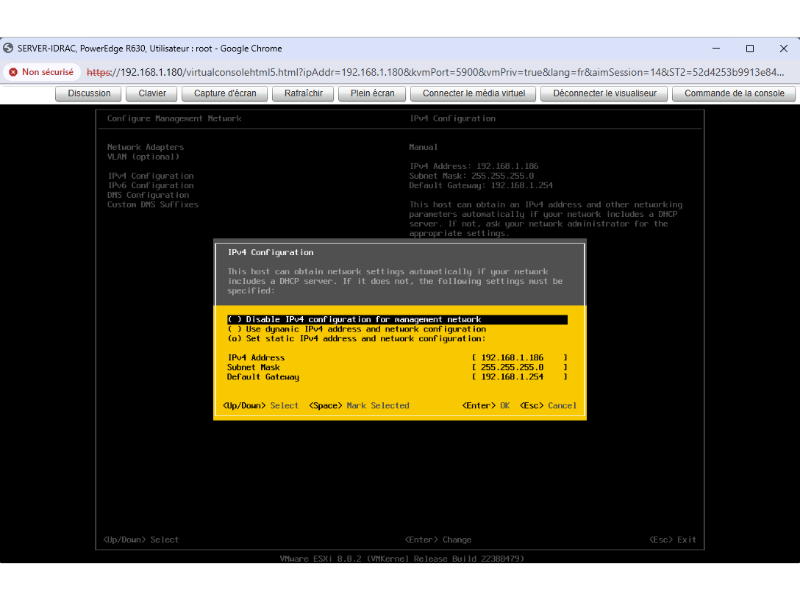

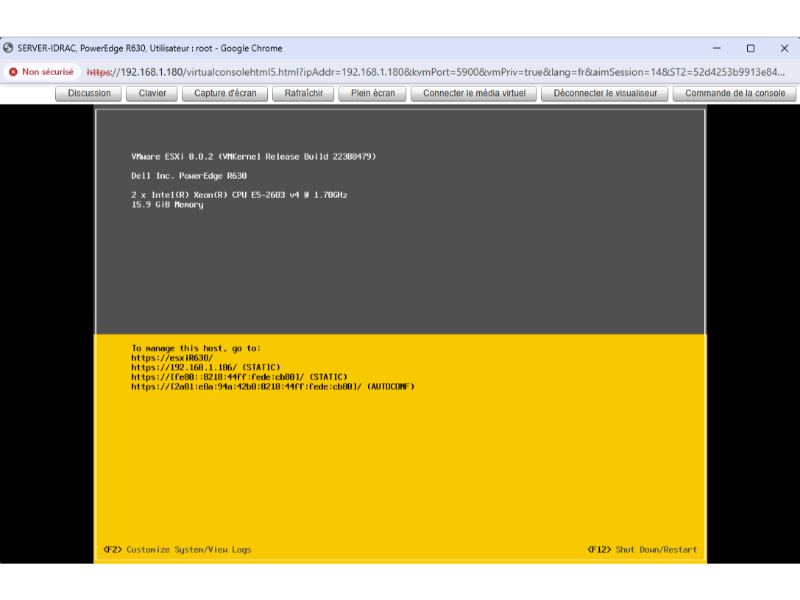

Pour déployer un cluster vSAN, il faut d’abord installer et configurer plusieurs hôtes ESXi,

les connecter à un vCenter, configurer le réseau vSAN avec des interfaces VMkernel dédiées,

puis créer un cluster dans vCenter.

Ensuite, on active la fonction vSAN et on ajoute les disques de chaque hôte dans des groupes de disques.

Enfin, un datastore vSAN est automatiquement généré, prêt à accueillir les machines virtuelles.

Étapes de déploiement d’un cluster vSAN :

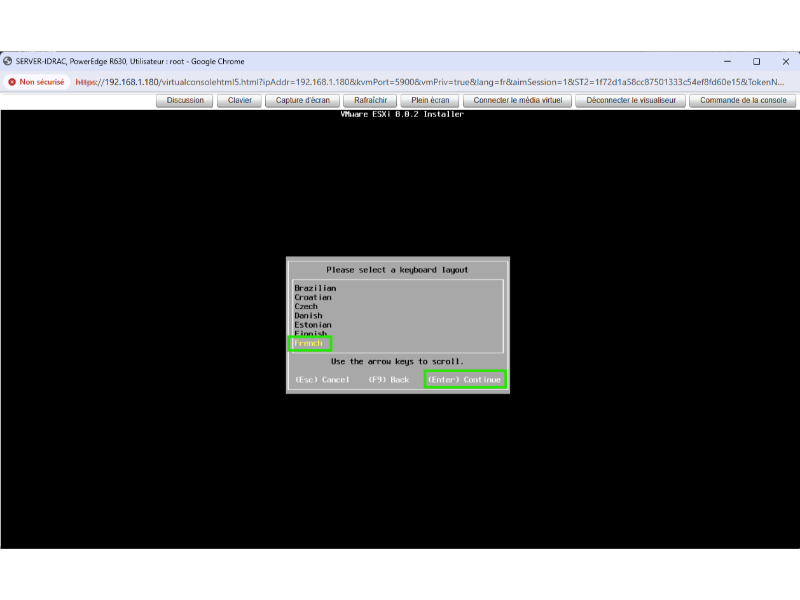

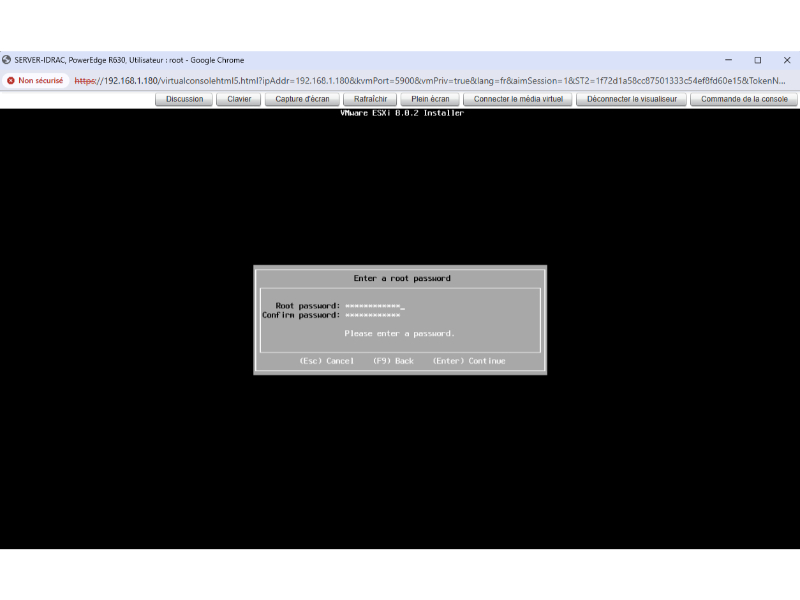

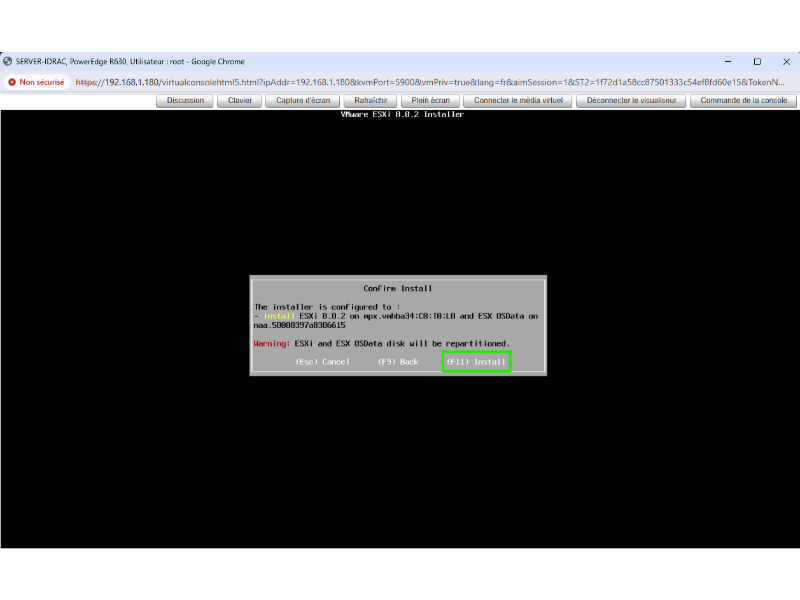

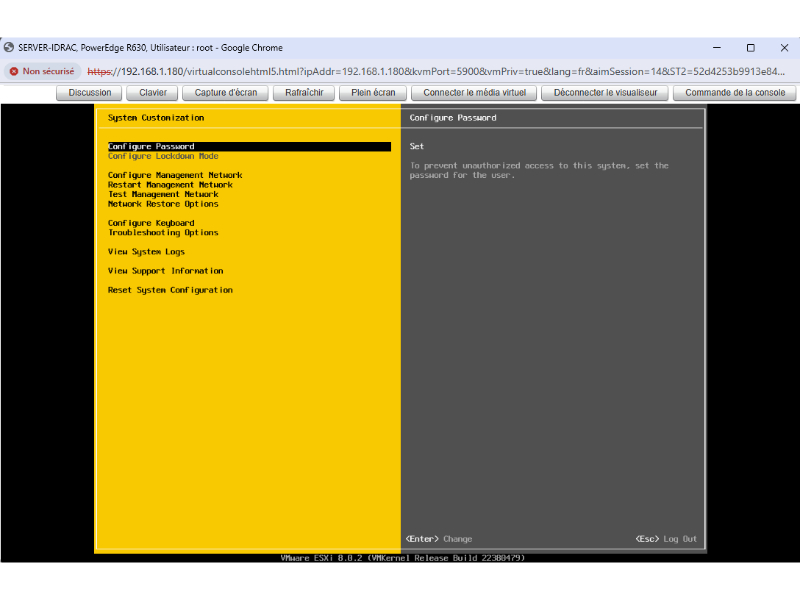

- 1. Installer et configurer au moins 2 hôtes ESXi.

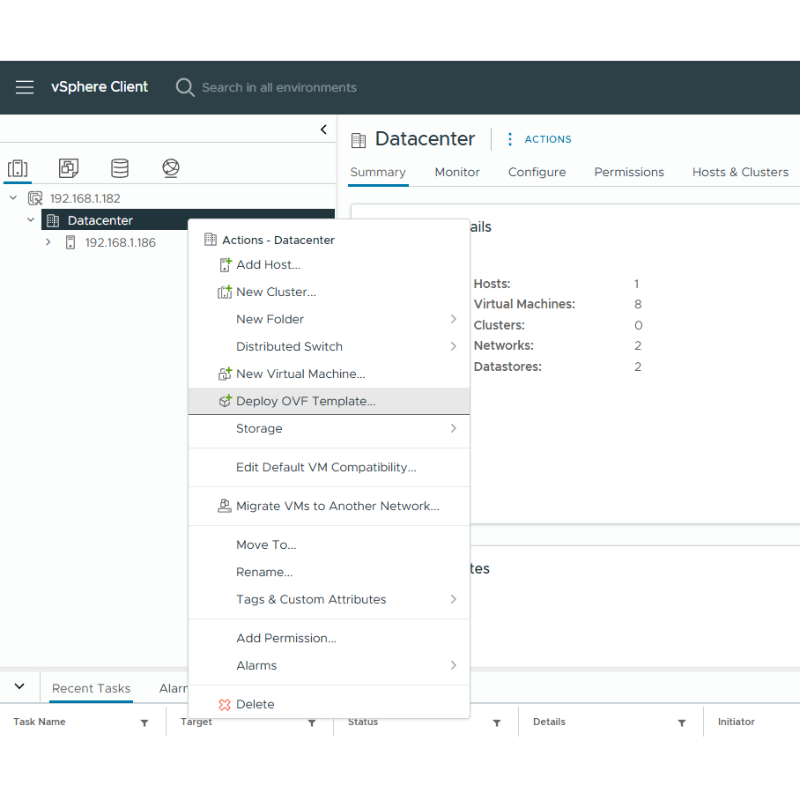

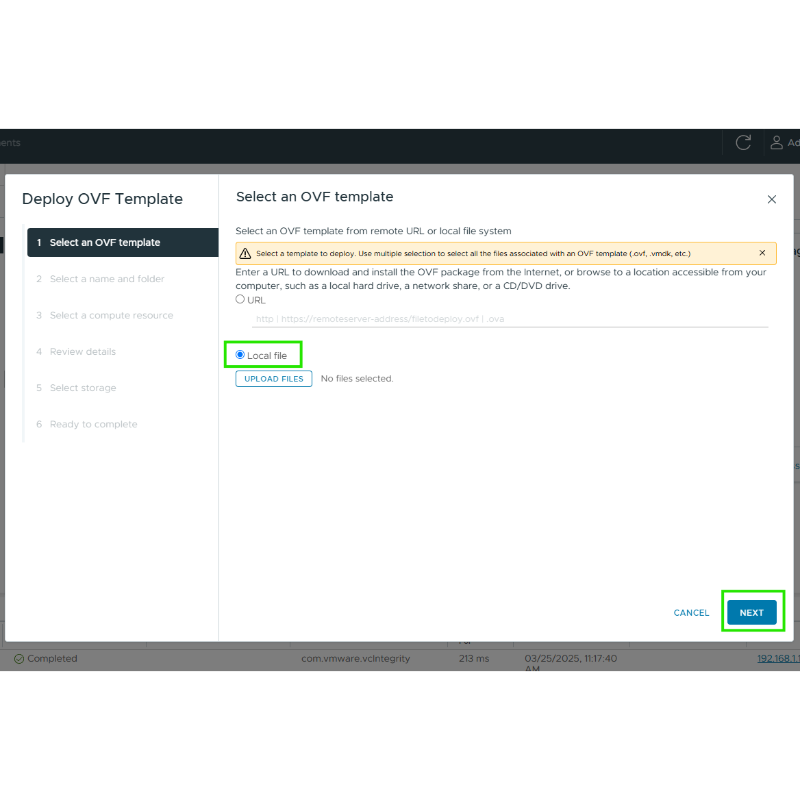

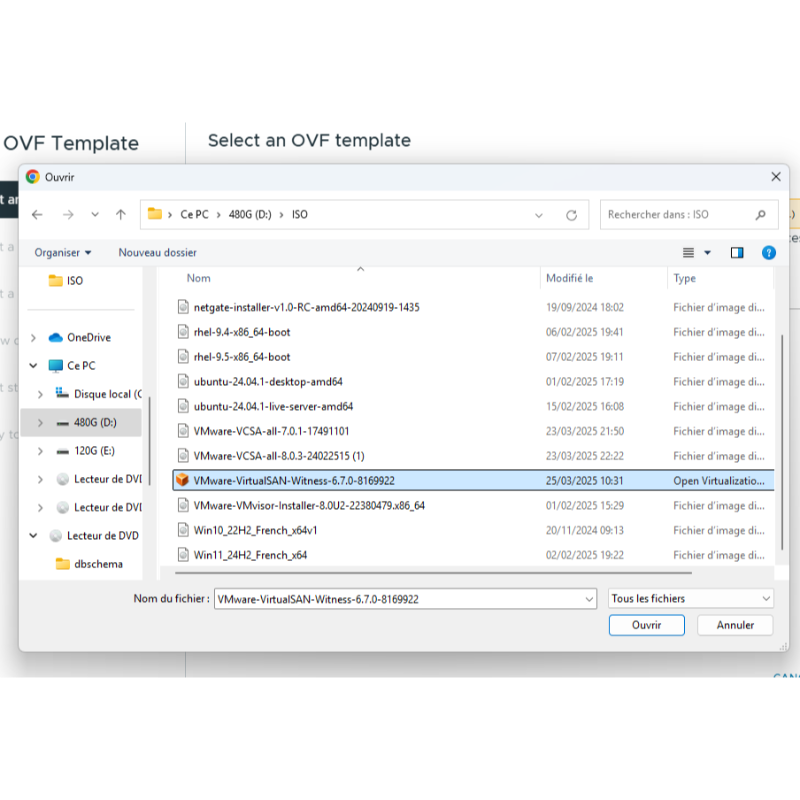

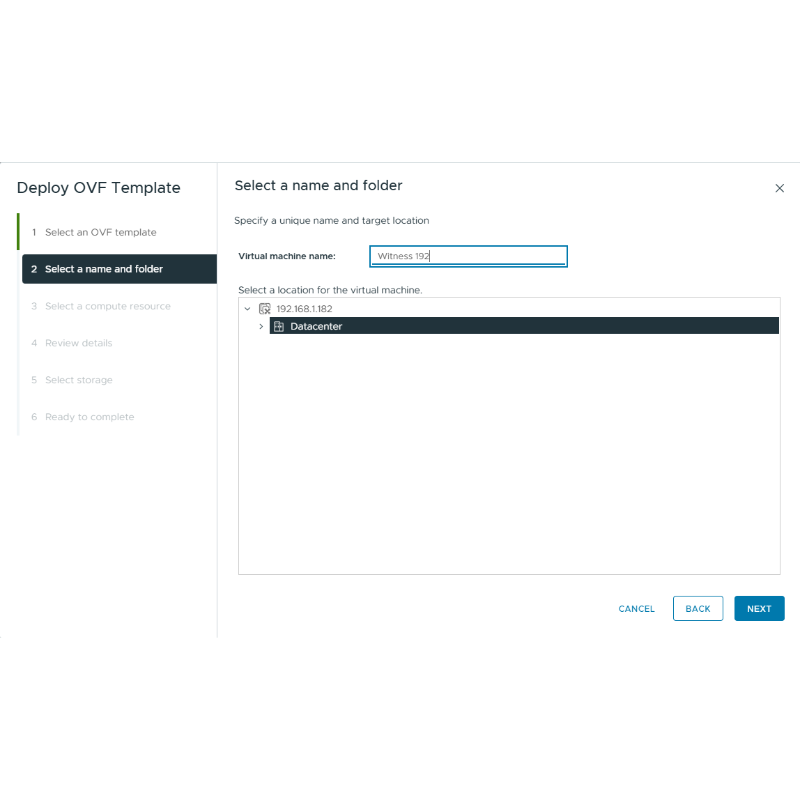

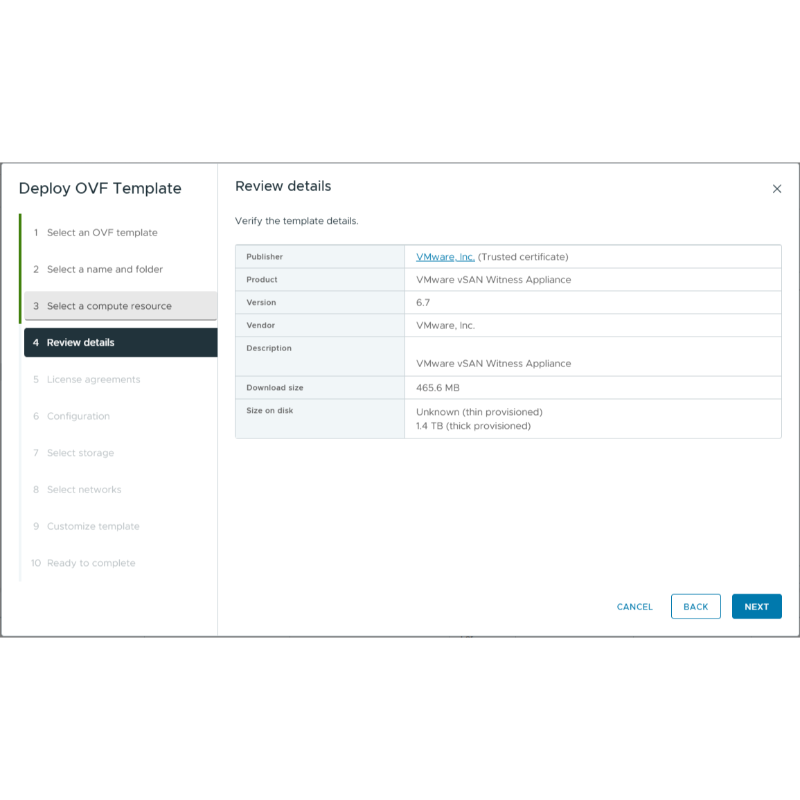

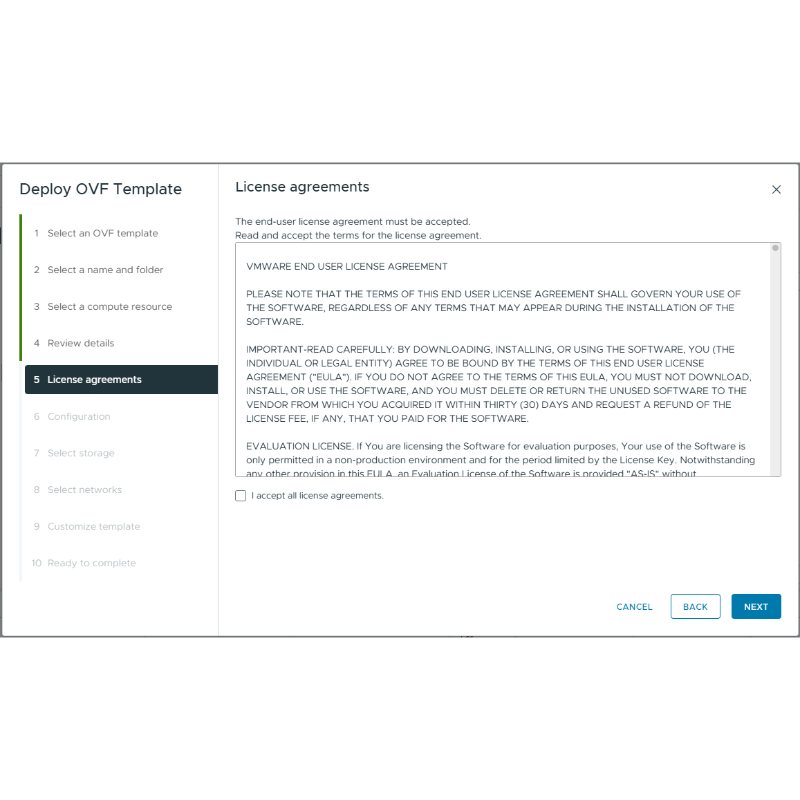

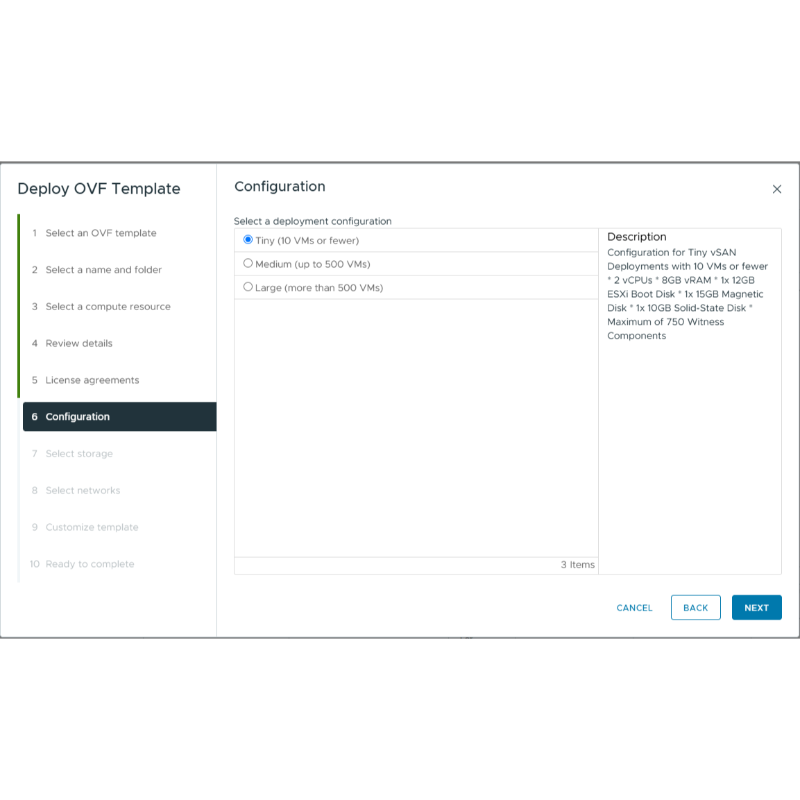

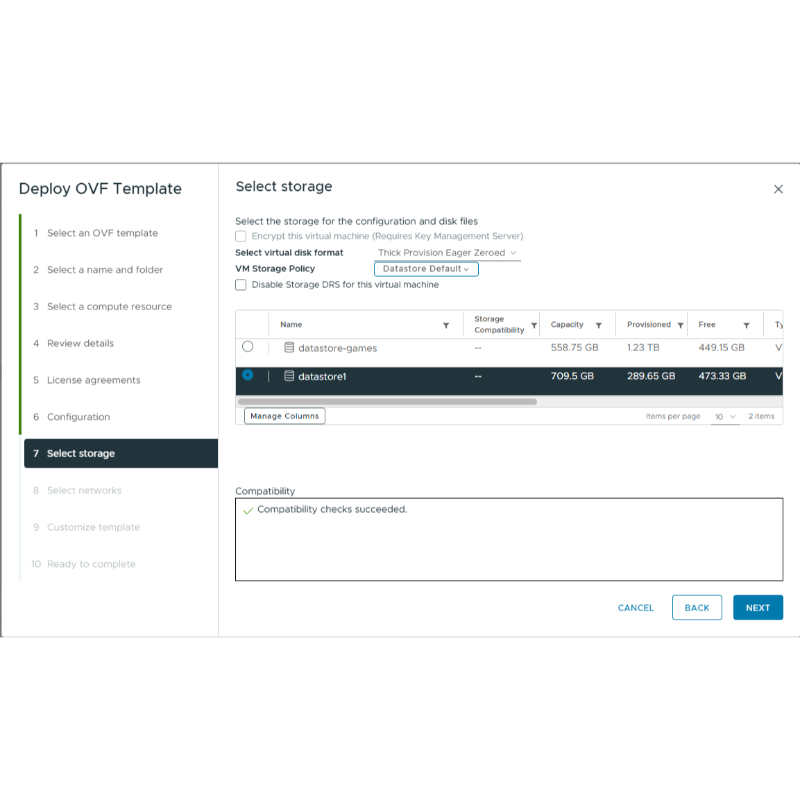

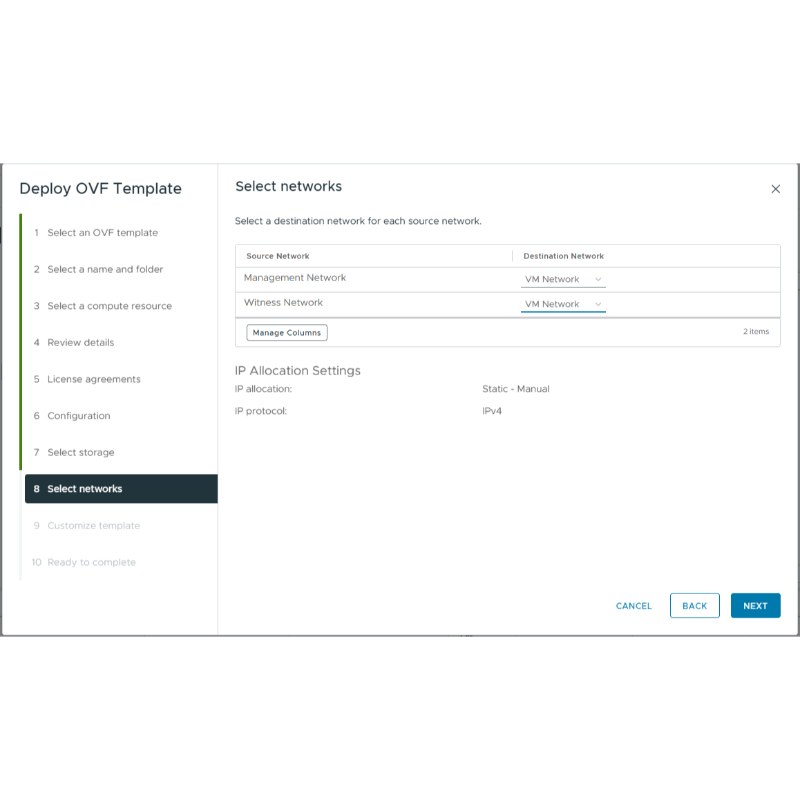

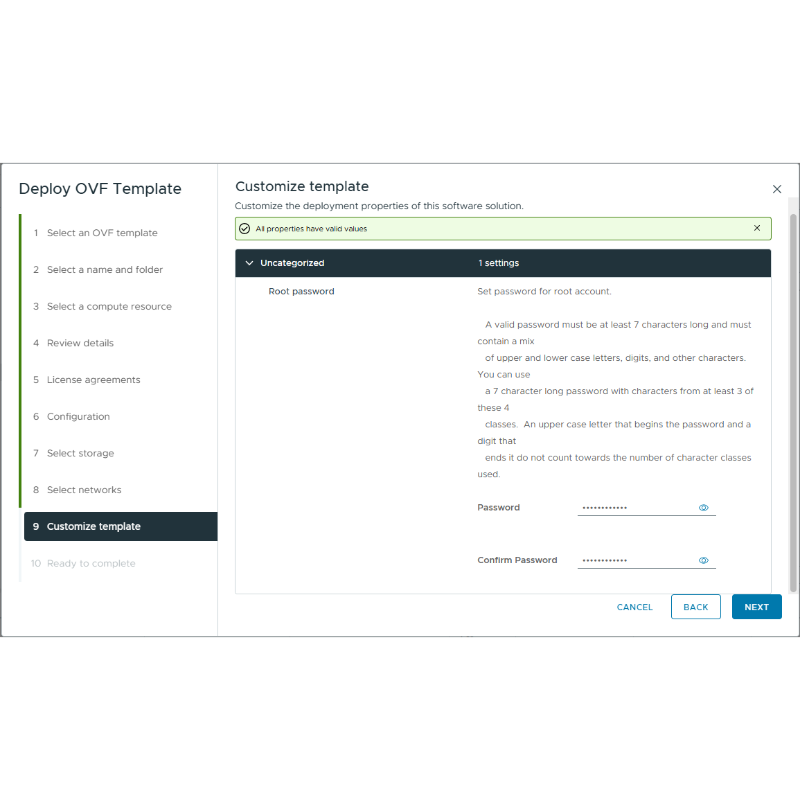

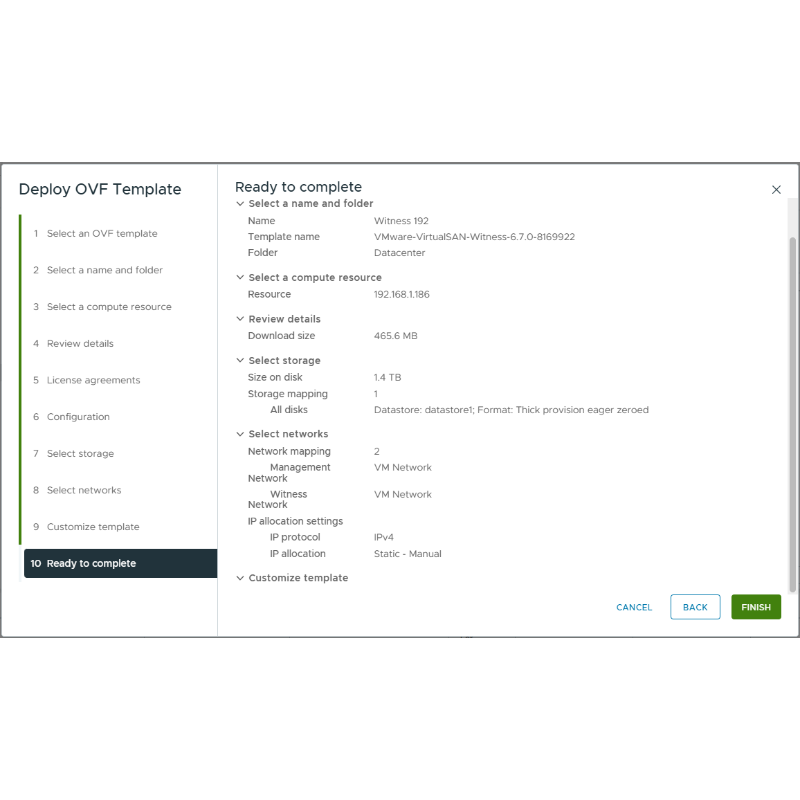

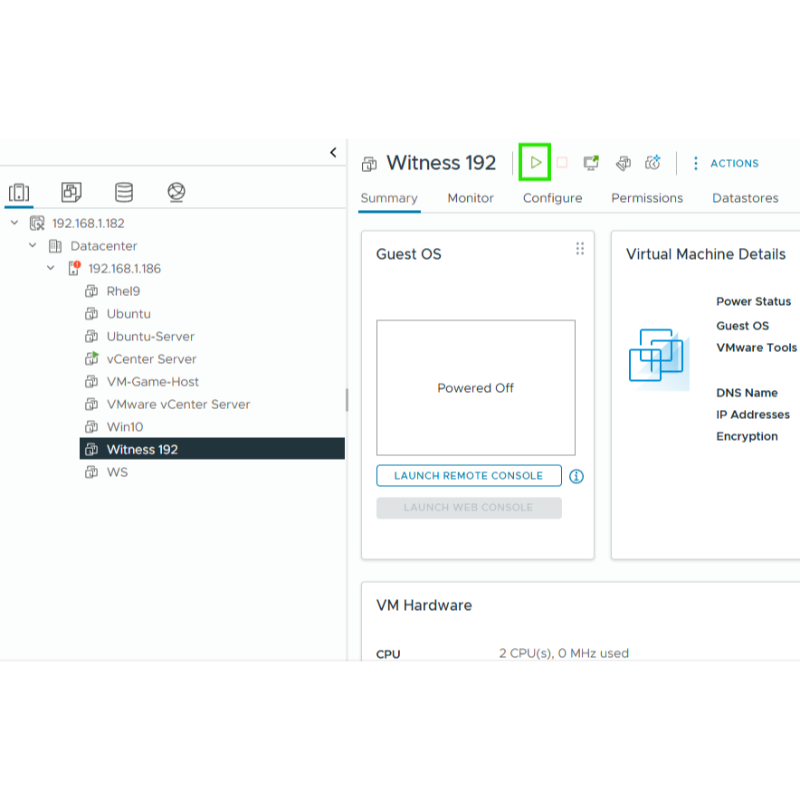

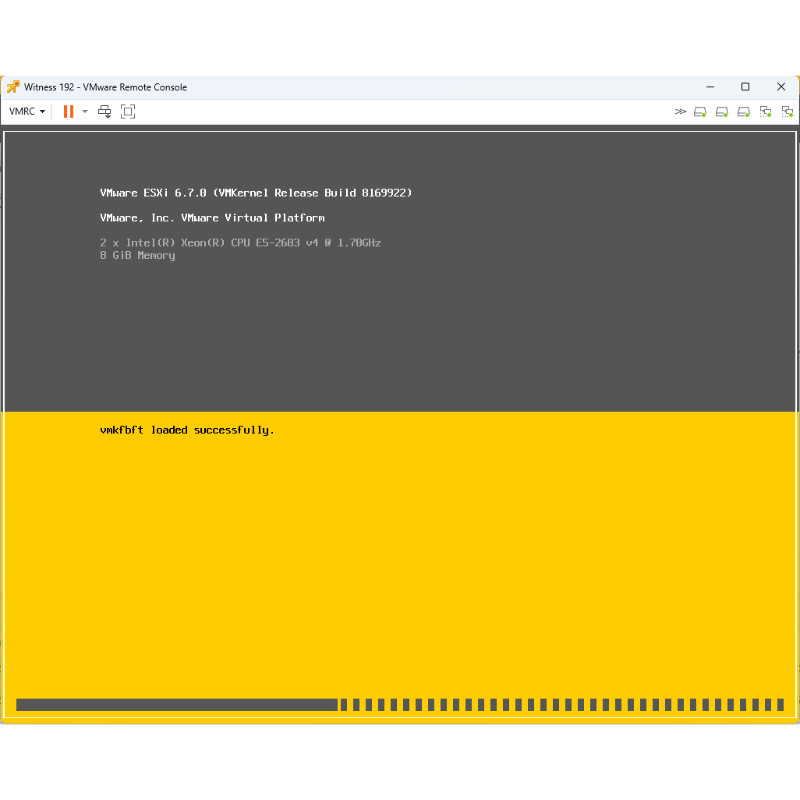

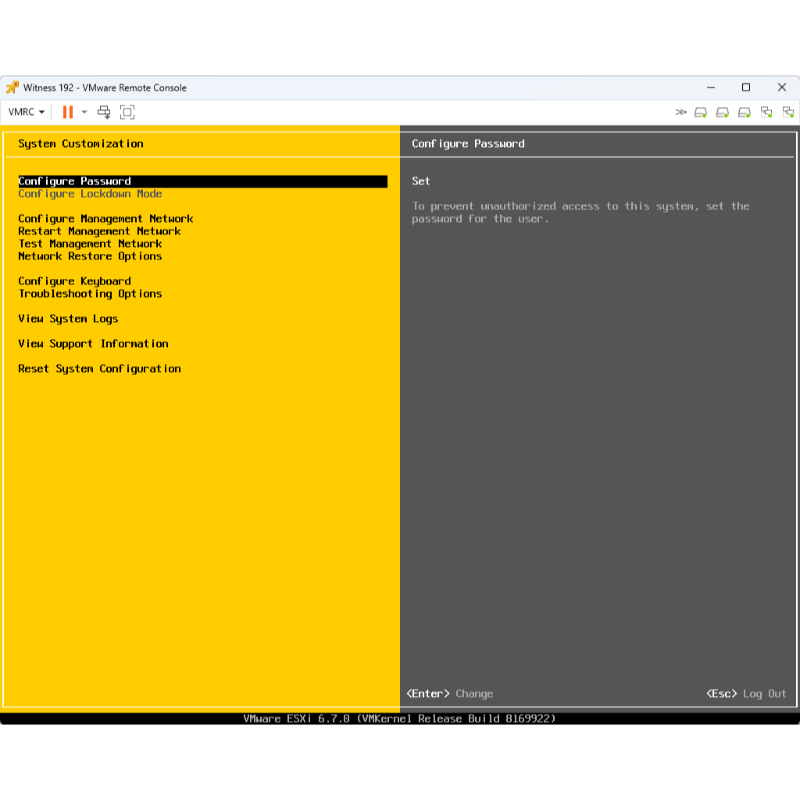

- 2. Déployer une machine Witness fournie par VMware.

- 3. Ajouter tous les hôtes (et le Witness) dans vCenter.

- 4. Créer un cluster et activer vSAN.

- 5. Configurer le réseau vSAN avec des interfaces VMkernel dédiées.

- 6. Réclamer les disques des hôtes et créer les groupes de disques.

- 7. Le datastore vSAN est automatiquement créé et prêt à être utilisé pour héberger les machines virtuelles.

Procédure de déploiement et configuration du vSAN

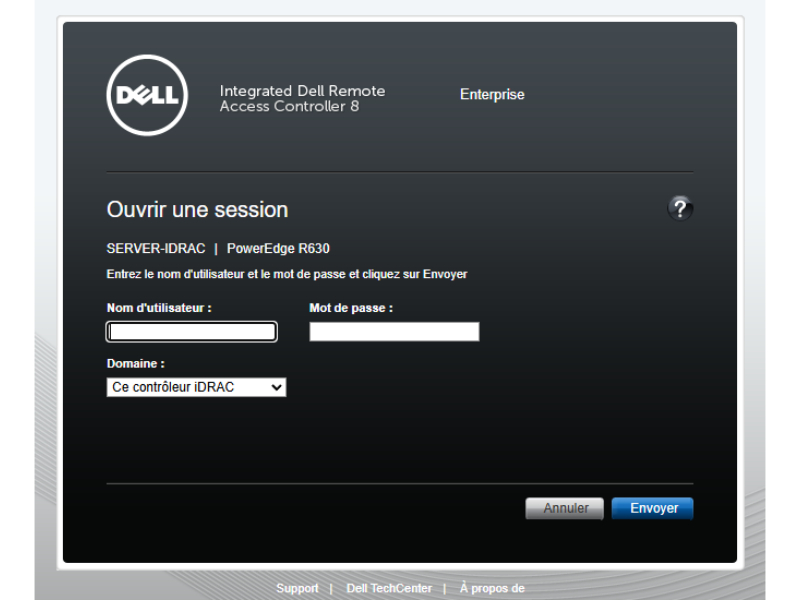

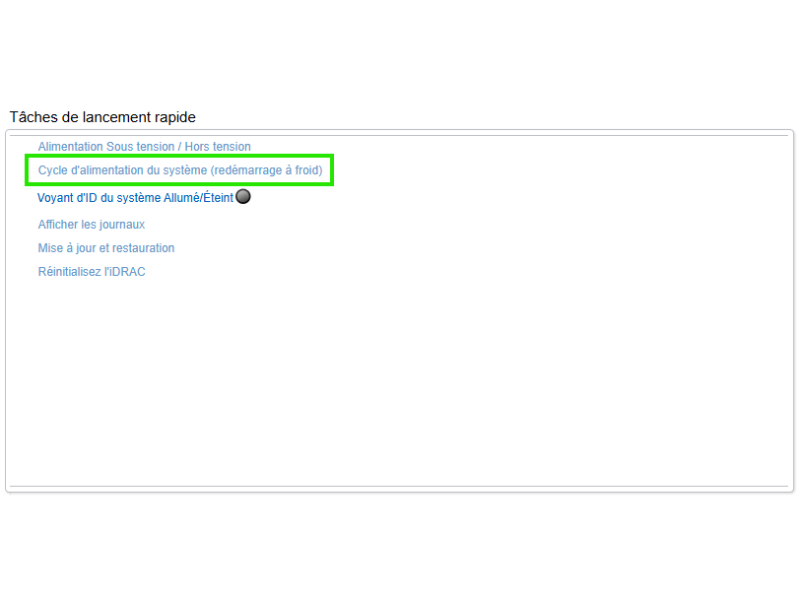

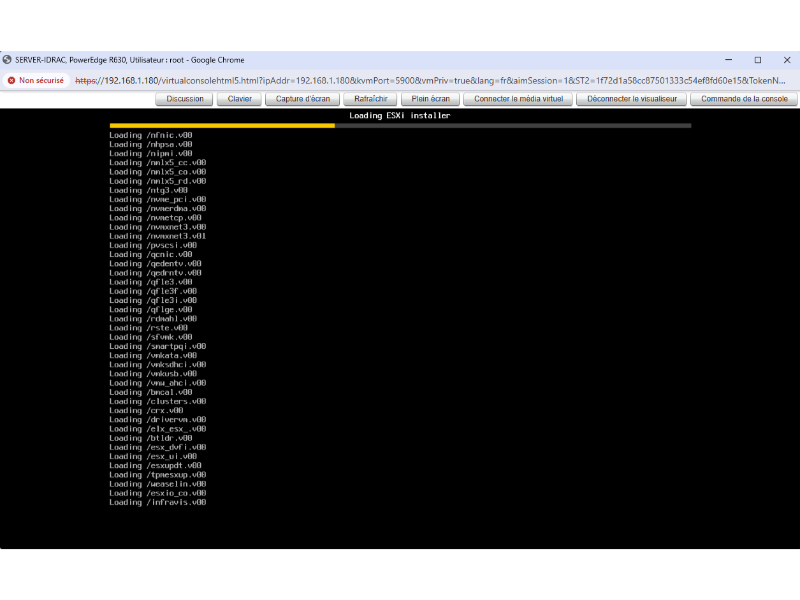

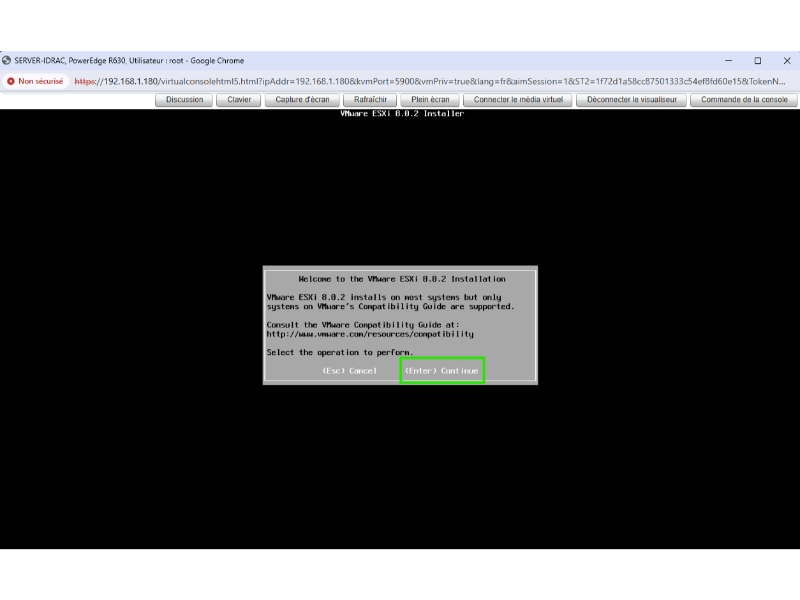

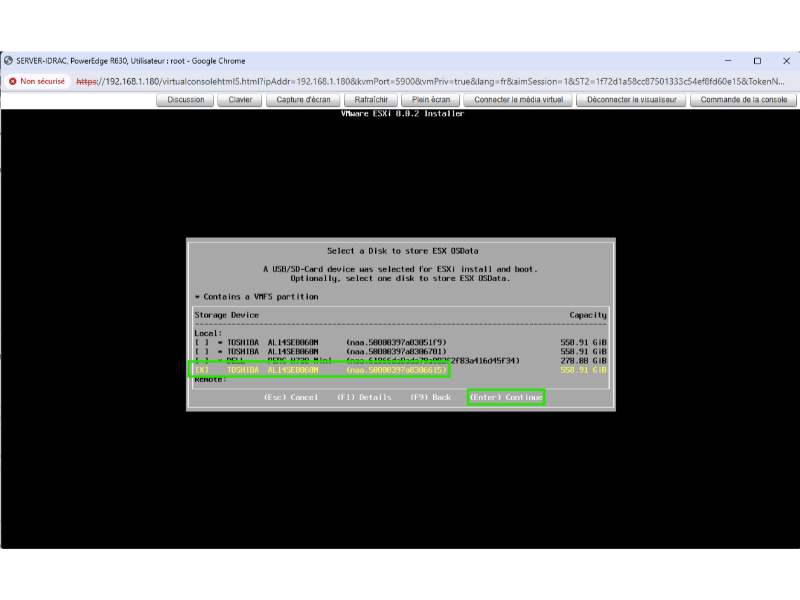

Déploiement d'un ESXi

Déploiement du Witness

Configuration du vSAN